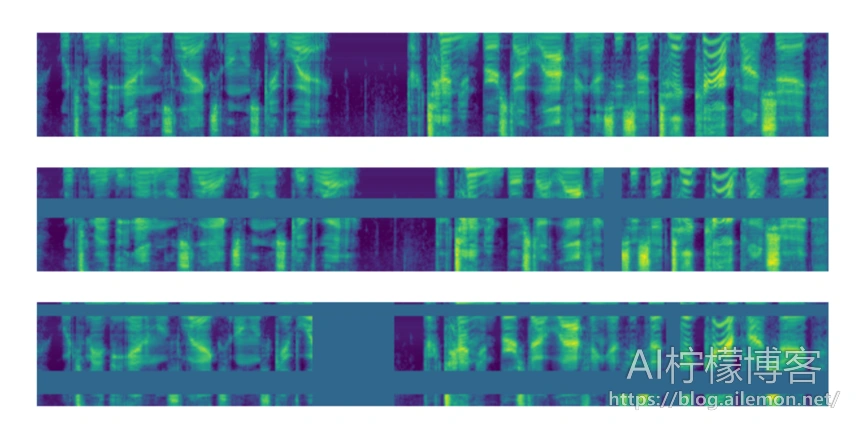

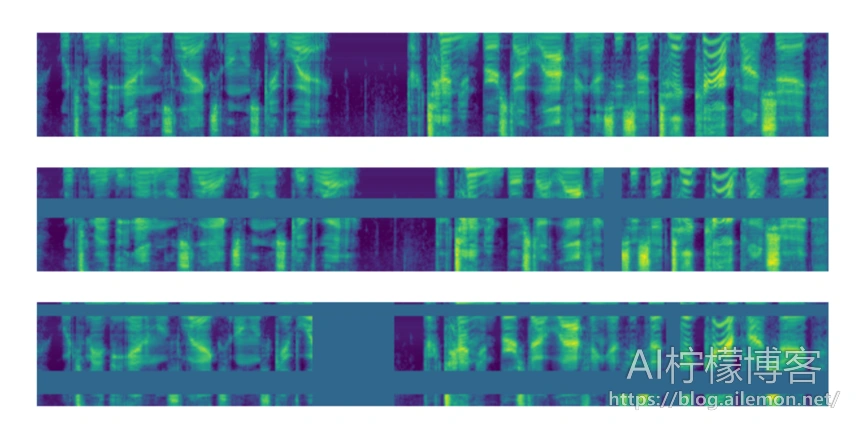

谷歌在2019年提出了用于语音识别数据增强的SpecAugment算法,基本原理是对频谱图进行各种遮盖,例如横向进行频率范围遮盖,以及纵向进行时间段遮盖,也可以将二者组合起来,如图所示。本文将以代码来介绍在实际应用中如何复现SpecAugment算法,并介绍如何将该代码应用到AI柠檬的ASRT语音识别系统( https://github.com/nl8590687/ASRT_SpeechRecognition )的训练中。

一个科技爱好者的个人博客

谷歌在2019年提出了用于语音识别数据增强的SpecAugment算法,基本原理是对频谱图进行各种遮盖,例如横向进行频率范围遮盖,以及纵向进行时间段遮盖,也可以将二者组合起来,如图所示。本文将以代码来介绍在实际应用中如何复现SpecAugment算法,并介绍如何将该代码应用到AI柠檬的ASRT语音识别系统( https://github.com/nl8590687/ASRT_SpeechRecognition )的训练中。

毕竟确实是有用的!每写一篇技术博客都是对自己技术学习的督促,也是对自己实际写作能力的考验,更是对自己独立思考和逻辑思维能力的锻炼。“天下文章一大抄”,还有“天下代码一大抄”,在互相抄来抄去的时代,能够自己原创写作,写出好文章,与自己原创从头一点一点编写好代码是一样的。有条件的话可以买一个自己的域名和服务器搭建独立博客,独立博客是自己的专属天地,如同自己的家一般,这里的一切规则由自己喜好主导,页面排版如何展示也自己说了算!在写博客前后,跟读者的交流也是自己的创意和想法的来源,如果自己有什么项目作品,博客还是发布自己的作品的绝佳平台!

在DNN-HMM架构的语音识别系统的声学模型中,训练一个DNN模型通常需要先进行帧和标签的对齐操作,此时需要先使用GMM通过EM算法不断迭代实现。而且隐马尔可夫假设一直饱受诟病,随着深度学习的发展,尤其是基于CTC的CNN和RNN模型的出现,使得实现端到端的语音识别声学模型成为了可能。CTC由于其强大的在时间序列上进行标签自动对齐的能力,可被用于语音识别、图像验证码(或者文本)识别和视频手势识别(手语识别)等问题中。

(更多…)熟悉AI柠檬博主的可能会知道,博主除了有搭建在公有云(阿里云和腾讯云等)上的博客和ASRT语音识别项目相关的网站等服务外,还在自己的局域网里搭建了一个物理的私有云服务器,用于个人数据文件的存储,以及一些计算的需求。并且,私有云上的部分服务也是可以通过公网访问的,而且部分公网上的服务也依赖于我的私有云,这样解决了数据存储安全性、数据访问便捷性和综合成本的节约的问题。或许你也需要一套这样的混合云解决方案!

RNN是循环神经网络的缩写,并且也是循环网络结构中的一种,我们通常使用这种网络模型来处理序列型的数据。语音识别处理的就是一个典型的有时间顺序的序列数据,自然语言文本也是。在一个普通的DNN网络中,层与层之间是全连接的,而每层中的神经元节点之间不存在任何连接,这样的一种普通DNN网络结构难以解决很多问题。以语音识别为例,不同时刻t的语音包含的字,在推理计算时,需要根据上下文来确定应该输出为什么字符,而且结果应当跟具体所在时刻t无关,否则会出现不同时间说相同的字会产生不同的识别输出的问题。

循环网络就解决了这个问题,这有点类似于隐马尔可夫模型,对于每一时刻的输入,所产生的输出值,不仅仅依赖于当前时刻t,还依赖于前N个时刻的输出值。这主要是通过在每一个循环层单元中,添加了一个记忆单元实现的。

(更多…)2020年计算机类专业的校招找工作情况可谓是“卷”,“僧多粥少”的局面依旧,尤其是算法岗,但其他岗位也水涨船高,hc和简历投递数悬殊的比例持续扩大。很多用人单位在要求的第一条就明确写到需要至少有一篇顶会或顶刊的论文,甚至会再次强调这一条很重要,让求职者明白岗位要求后再投递简历,更有甚者有形无形中会对求职者的学历和毕业学校有要求。

那么难道我们上大学、读研究生学计算机专业的求职就业前景真的就越来越黯淡了吗?AI柠檬博主这样看。

卷积神经网络是模式识别分类常用的网络结构之一,在大规模的图像识别等方面有着很大的优势。本文将总结卷积层、反卷积层、感受野、权重参数数量等卷积神经网络相关的原理和计算过程。

(更多…)ASRT语音识别项目现在已经开放免费测试版的公共API调用接口了,欢迎大家使用Demo客户端或客户端SDK进行调用测试,测试用API的接口链接:https://api.ailemon.net/asrt/v1/ ,详细使用方法请查看ASRT项目文档内容( https://asrt.ailemon.net/docs/ )。由于目前部署的API服务器的硬件配置性能和网络性能有限,请使用ASRT的Demo客户端或者客户端SDK,在正常使用情况下进行测试,避免高并发调用,以防止服务器负载过高。

(更多…)

在YOLOv4的论文中,有一个很重要的BoF技巧,就是马赛克数据增强。很多人刚听说马赛克数据增强的时候,不知道这究竟是一种什么样的数据增强方案,其实,它是CutMix之类的图片预处理方案的一种推广。

(更多…)近日,AI柠檬网站上线了站内搜索引擎,并且支持语音搜索功能,以方便一个地方即可搜索包括AI柠檬的中文博客、英文博客和ASRT语音识别项目网站和文档等所有站点页面,大大优化了用户体验。搜索网站地址为:https://s.ailemon.net/ ,也可通过中文博客底部的搜索框进行搜索。打开后,直接在搜索框中输入文本即可,或点击“话筒”图标,说话完毕后,再次点击即可直接跳转到搜索结果页面。其中,语音搜索功能由ASRT中文语音识别项目实现和驱动。