最近这一段时间,TensorFlow 2.0发布,这是你从没有体验过的全新的版本,为了能够尽快接触和体验到2.0新版本的特性,AI柠檬博主从mnist手写数字识别Demo入手,开始学习TensorFlow 2.0版。由于tf2原生内置keras包,无需另外安装,本样例将以tf.keras代码实现,并且在这一过程中发现,原本的keras代码仅需极少数改动即可迁移到TensorFlow 2.0,这对于之前一直使用Keras的用户来说,可谓非常友好了。

分类: 机器学习及应用

-

机器学习:梯度下降算法是如何工作的

在进行机器学习的时候,我们常常要使用到各种各样的优化算法,以此使得模型能够尽可能收敛到最优的解,而梯度下降(Gradient Descent)算法就是这样的一种无约束的一阶优化算法,并且,根据算法的确定性和随机性,可分为批量梯度下降法和随机梯度下降法。

-

机器学习:感知机模型

感知机(perceptron)是线性二分类模型,输入是实例的特征向量,输出是用“+1”和“-1”表示的实例类别。AI柠檬曾在两年半前的文章中,详细介绍过机器学习中的逻辑斯蒂回归模型,它是感知机模型的一种变种。作为判别模型,感知机将实例用一个超平面划分为正负两类,是神经网络和支持向量机的基础。

-

使用N-DenseNet实现城市声音事件分类模型

现代社会中,智慧城市的构建是一个当前的趋势,其中包括利用传感器网络收集目标城市的城市声音时间的信息采集和分类研究用相关音频数据并进行分析,这对于是提高智能感知水平的重要一步。来自江南大学的一研究团队,通过采用N-DenseNet网络模型,实现了对城市声音事件的分类,其一阶和二阶模型的分类准确率达到了83.63%和81.03%,并且具有良好的泛化能力。

-

[翻译]Deep Speech:中文和英文中的端到端的语音识别

本文翻译自百度Deep Speech 论文

原文:

https://openreview.net/forum?id=XL9vPjMAjuXB8D1RUG6L百度研究院 – 硅谷AI实验室

Dario Amodei, Rishita Anubhai, Eric Battenberg, Carl Case, Jared Casper, Bryan Catanzaro,

Jingdong Chen, Mike Chrzanowski, Adam Coates, Greg Diamos, Erich Elsen, Jesse Engel,

Linxi Fan, Christopher Fougner, Tony Han, Awni Hannun, Billy Jun, Patrick LeGresley,

Libby Lin, Sharan Narang, Andrew Ng, Sherjil Ozair, Ryan Prenger, Jonathan Raiman,

Sanjeev Satheesh, David Seetapun, Shubho Sengupta, Yi Wang, Zhiqian Wang, Chong Wang, Bo Xiao, Dani Yogatama, Jun Zhan, Zhenyao Zhu -

MCNN-CTC:将语音识别错误率再降12%

近些年来,随着深度学习的发展,语音识别的准确率已经达到较高水平。卷积神经网络的应用,对于语音识别系统准确率的提升起了至关重要的作用。虽然普通的深度卷积神经网络,随着深度的增加,准确率应该会有所提升,但是其在宽度上的限制,使得其可能无法捕捉到人类语音信号中足够的信息。近日,江南大学一团队提出了深度多路卷积神经网络MCNN-CTC模型,在没有语言模型的情况下,可将端到端声学模型的错误率相比DCNN-CTC模型下降1.10%-12.08%,并有着更好的性能。相关论文发表在Intelligent Robotics and Applications 2019。

-

[翻译]使用CTC进行序列建模

原文:https://distill.pub/2017/ctc/

Hannun A. Sequence modeling with ctc[J]. Distill, 2017, 2(11): e8.

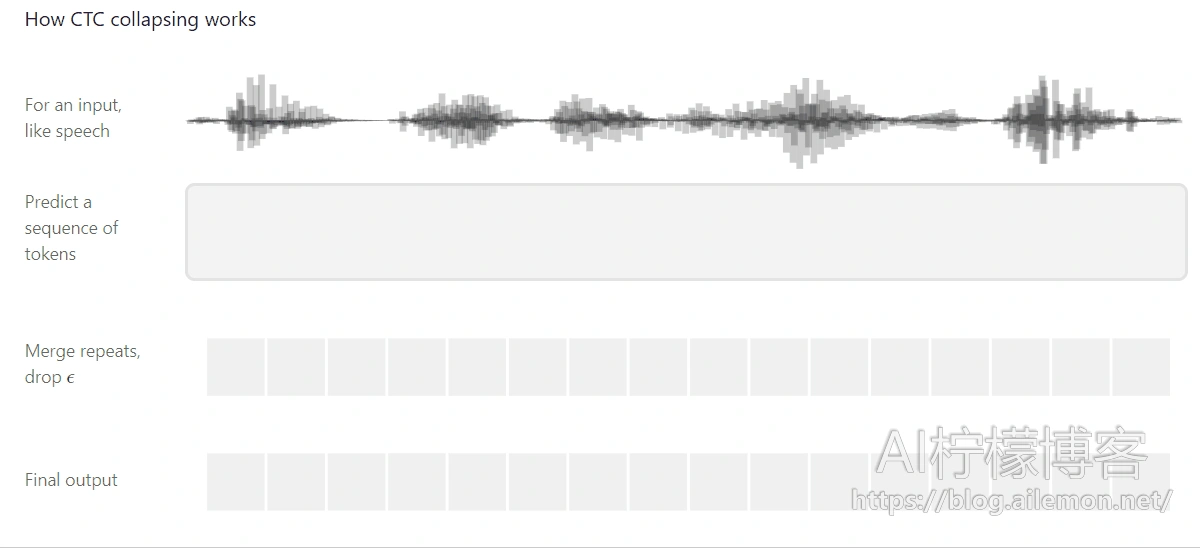

下面是连结时序分类(CTC)的一个可视化指导图,CTC是一种用于在语音识别,手写识别和其他序列问题中训练深度神经网络的算法。

CTC的工作原理 -

为keras基于TensorFlow后端实现多GPU并行计算

在训练深度学习模型的时候,尤其是大规模深度学习模型的训练,我们可能会遇到一些问题,比如觉得计算速度不够快,或者显存不够用,然而,我们却无法为了提升速度或者降低存储空间占用,从而缩小模型的规模或者数据输入输出的尺寸等。这时,我们可以通过多GPU并行计算来解决这一问题。在Keras框架中,虽然本身内置了一些可以多GPU并行计算的API,但是似乎不起作用而且还常常报错。这里有一份基于TensorFlow后端实现的多GPU并行计算的模块,在Keras上亲自测试通过,可以起到通过多卡扩展显存空间和取得加速比的作用。

-

机器学习:朴素贝叶斯分类器

朴素贝叶斯分类器(naïve Bayes classifier)是机器学习中的一种假设特征之间强独立的基于贝叶斯定理的简单概率分类器。朴素贝叶斯自20世纪50年代起就已经广泛研究,具有快速易实现的优点,这种机器学习方法在有适当的预处理时,可以与这个领域包括支持向量机在内的更先进的方法相竞争[1]。本文将主要介绍朴素贝叶斯分类器算法的原理,并以一个小实例解释其在实际中是如何应用的。

-

深度学习:基于mxnet的mnist手写数字识别

mnist手写数字识别是入门深度学习,或者学习一个新的深度学习框架时,最容易上手的程序。本文中,我将使用mxnet深度学习框架在mnist数据集上实现一个简单的手写数字识别模型。